目录

- 1、卷积

- 2. 卷积神经网络

- 2.1 卷积层

- 2.2 padding

- 2.3 多kernel

- 2.4 特征学习

1、卷积

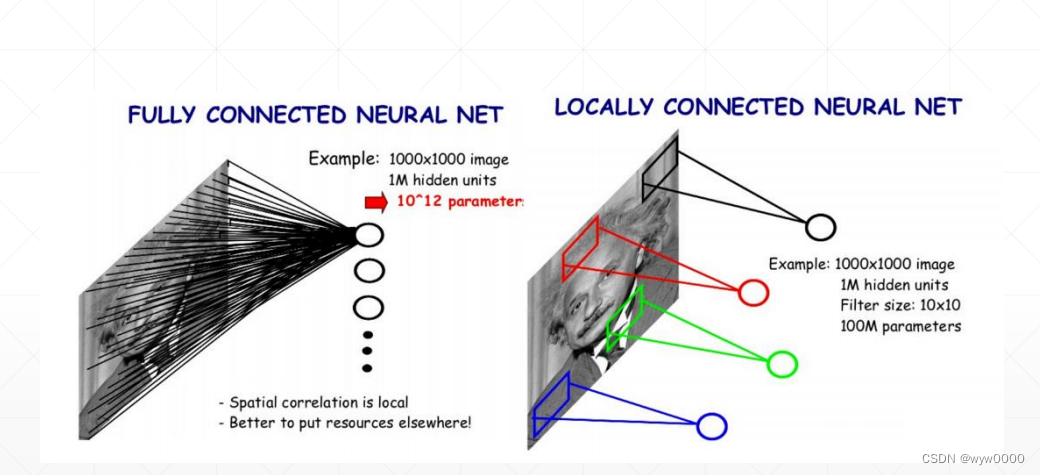

为了减少网络的复杂度,增加一个滑动的矩阵小窗口,比如minist数据集输入是28x28=784,也就是说除输入层外,其他层的每个节点与上层都有784条权重连线,而增加一个3x3的滑动窗口后,连线就变成了9,这样大大减少了参数量。这里使用了信号中的卷积运算,即对应元素相乘再累加,因此3x3的滑动窗口被称为卷积核,进行的运行叫卷积运算。

上图是爱因斯坦头像,如果使用全连接,那么参数量是 1 0 12 10^{12} 1012,而使用10x10的卷积运算后,参数量降到了100M。

2. 卷积神经网络

2.1 卷积层

使用卷积核进行卷积运算的层称之为卷积层

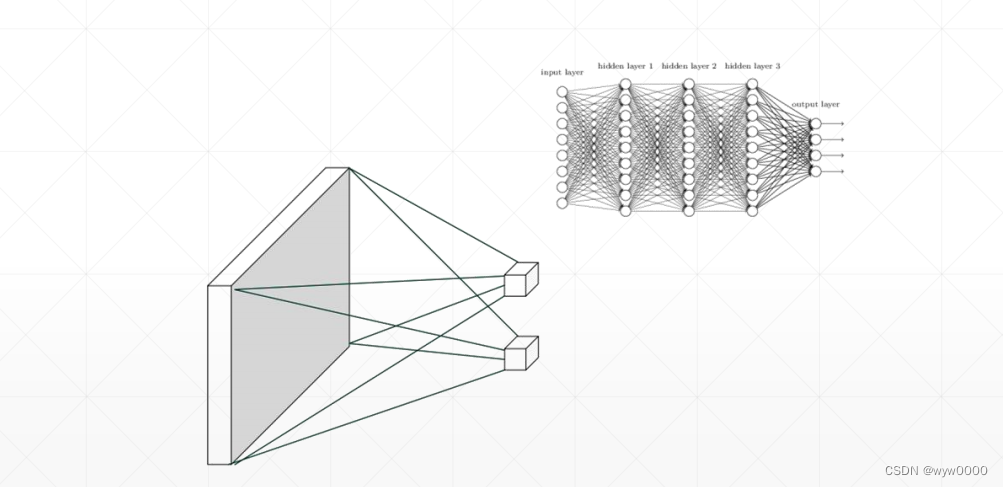

如下图:使用一个3x3的卷积核,先在x方向上移动,再在y方向上移动,每次移动一格,进行卷积运算,计算出对应元素的值,最后得到新的feature map

2.2 padding

从上边动图发现,经过卷积后,feature map比之前小了,原来5x5变成了3x3,那么怎么保证原大小输出呢?

如下图所示:分别在x和y方向上各增加一行,权值为0,这样再做卷积运算就可以输出原大小了。

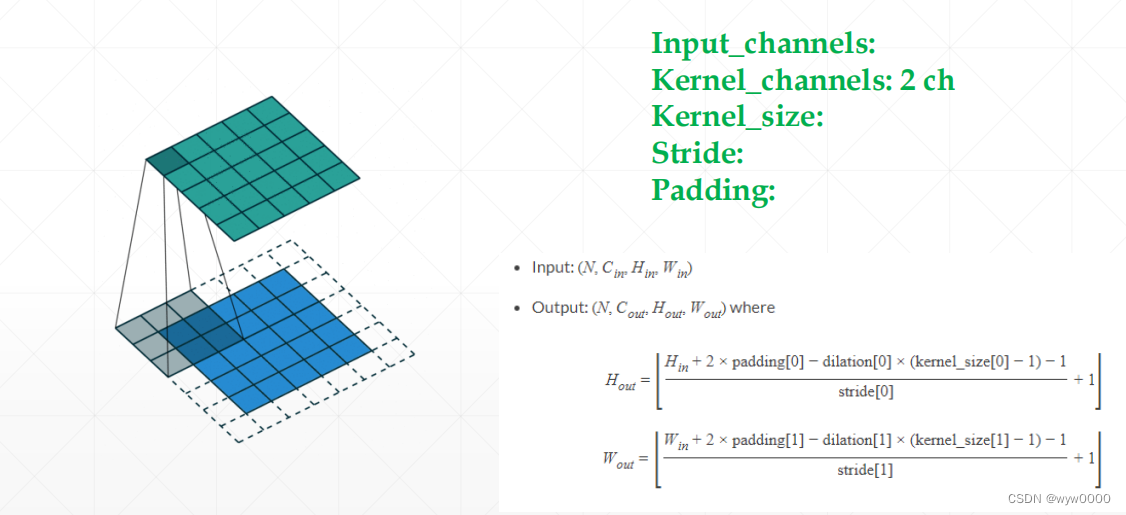

Input_channels:比如RGB三个通道

Kernel_channels:几种核,比如blur、sharpen等操作得核

Kernel_size:几×几的核,比如:3x3 5x5

Stride:步长,卷积核每层移动几个,1,2

Padding:0, 1, 1

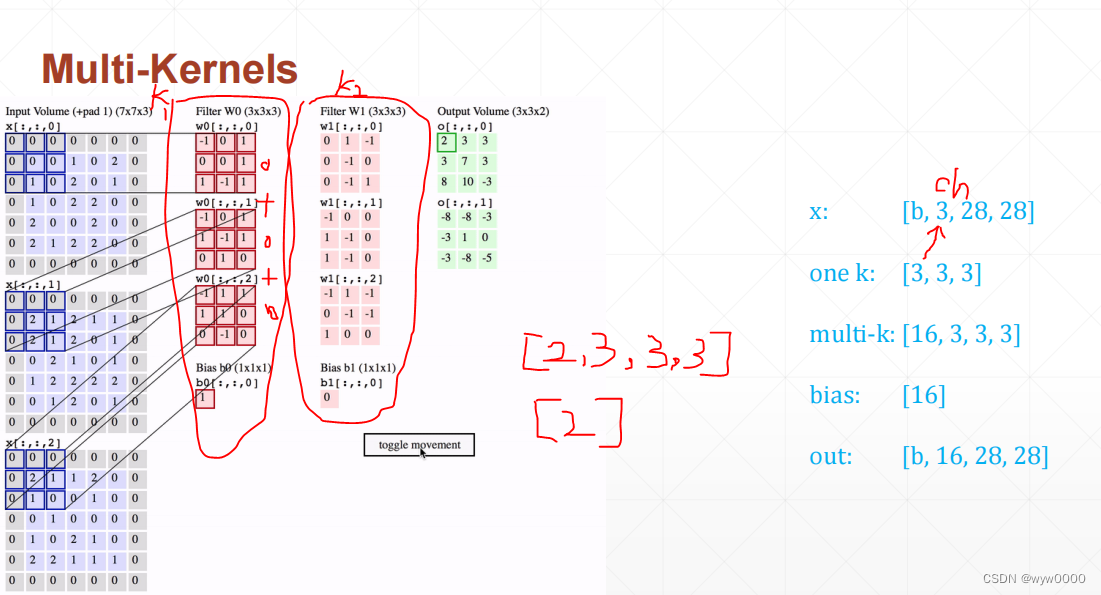

2.3 多kernel

下图中有两个kernel,k1和k2,input channel是3,因此每个kernel有3个相同的Window与之对应,也就是说input channel与kernel的window数必须一致,multi-k:[16,3,3,3],中的数字分别表示有16个kernel,每个kernel有3个window与input channel对应,window大小是3x3。而下图实际有2个kernel,kernel维度表示为[2,3,3,3]

最后输出feature map是3x3是怎么来的呢?input 每个通道元素与对应window元素相乘累加后得到一个值,再把3个通道的值相加就得到了output的一个值。

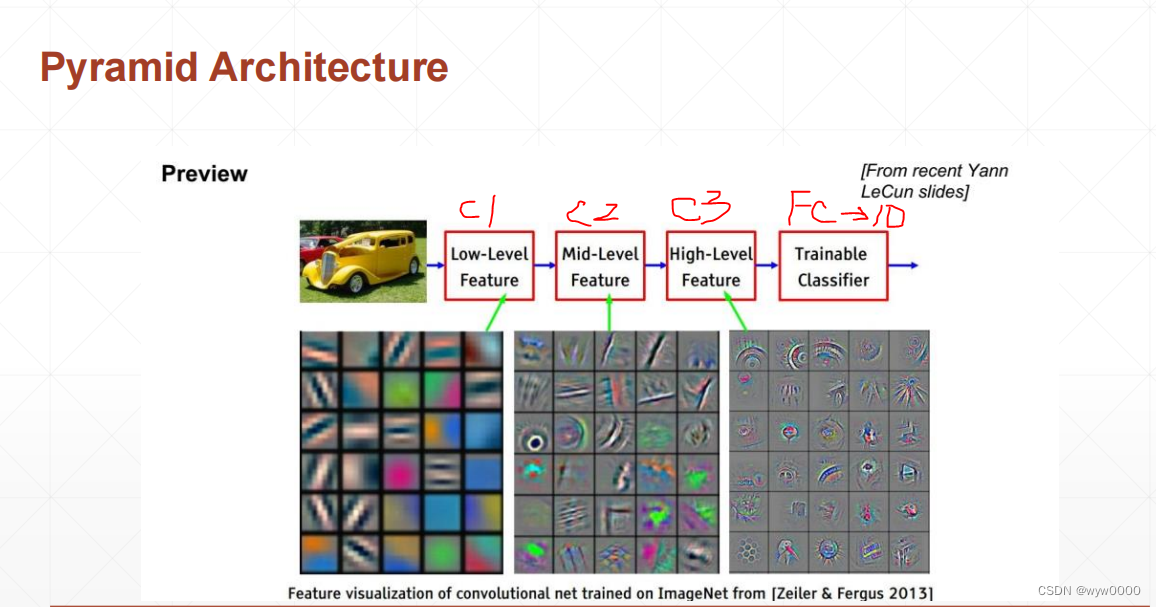

2.4 特征学习

下图表示了特征学习的一个过程:conv1提取了低级特征,比如:汽车的颜色;conv2提取了中级别的特征,比如:轮廓;conv3提取了高级别的特征,比如:汽车的灯、轮子,最后是全连接层,输出分类。