一、LeNet概述

1. 历史地位

- 开创性模型:首个成功应用的卷积神经网络(1998年)

- 应用场景:手写数字识别(MNIST数据集)、银行支票识别

- 提出者:Yann LeCun团队(论文《Gradient-Based Learning Applied to Document Recognition》)

2. 核心创新

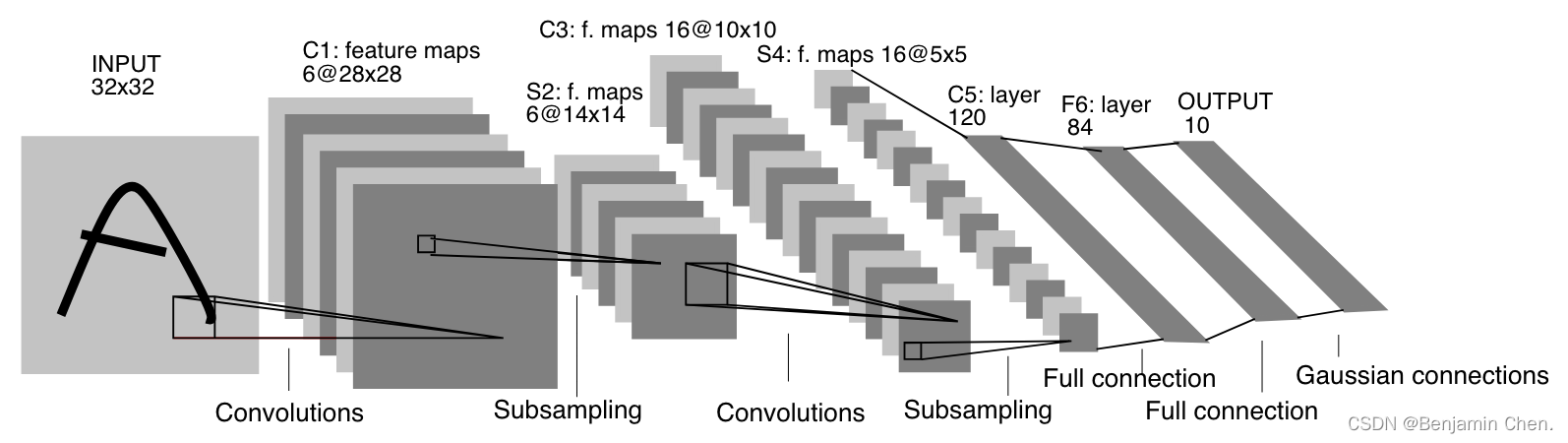

二、网络结构详解(LeNet-5)

1. 经典架构图

2. 各层参数说明

| 层级 | 类型 | 参数 | 输出尺寸 | 激活函数 |

|---|---|---|---|---|

| 输入层 | - | 32x32x1 | 32x32x1 | - |

| C1 | 卷积层 | 6个5x5卷积核,stride=1 | 28x28x6 | Sigmoid |

| S2 | 池化层 | 2x2平均池化,stride=2 | 14x14x6 | - |

| C3 | 卷积层 | 16个5x5卷积核,stride=1 | 10x10x16 | Sigmoid |

| S4 | 池化层 | 2x2平均池化,stride=2 | 5x5x16 | - |

| C5 | 全连接 | 120个神经元 | 120x1 | Sigmoid |

| F6 | 全连接 | 84个神经元 | 84x1 | Sigmoid |

| 输出层 | 全连接 | 10个神经元 | 10x1 | Euclidean RBF |

三、关键技术创新点

1. 卷积操作

# 现代PyTorch实现示例

conv1 = nn.Conv2d(1, 6, kernel_size=5, stride=1)

- 局部感受野:5x5窗口扫描输入

- 权值共享:相同卷积核检测不同位置特征

- 特征映射:通过不同卷积核提取多样化特征

2. 下采样(Subsampling)

pool = nn.AvgPool2d(kernel_size=2, stride=2)

- 降维作用:减少计算量

- 平移不变性:增强模型鲁棒性

- 原始实现:使用可训练参数的加权平均

四、现代改进实现(PyTorch版)

import torch.nn as nnclass LeNet(nn.Module):def __init__(self, num_classes=10):super().__init__()self.features = nn.Sequential(nn.Conv2d(1, 6, kernel_size=5), # C1nn.Sigmoid(),nn.AvgPool2d(kernel_size=2, stride=2), # S2nn.Conv2d(6, 16, kernel_size=5), # C3nn.Sigmoid(),nn.AvgPool2d(kernel_size=2, stride=2), # S4)self.classifier = nn.Sequential(nn.Linear(16*5*5, 120), # C5nn.Sigmoid(),nn.Linear(120, 84), # F6nn.Sigmoid(),nn.Linear(84, num_classes))def forward(self, x):x = self.features(x)x = torch.flatten(x, 1)x = self.classifier(x)return x

五、训练配置建议

| 参数 | 原始值 | 现代改进建议 |

|---|---|---|

| 输入尺寸 | 32x32 | 保持原始尺寸或调整到28x28 |

| 激活函数 | Sigmoid | ReLU(需调整学习率) |

| 池化方式 | 平均池化 | 最大池化(保留显著特征) |

| 损失函数 | MSE | CrossEntropy(配合Softmax) |

| 优化器 | - | Adam (lr=0.001) |

| 正则化 | - | 添加Dropout(0.5) |

六、数学原理推导

1. 卷积运算公式

( I ∗ K ) i j = ∑ m = 0 4 ∑ n = 0 4 I i + m , j + n K m , n (I*K)_{ij} = \sum_{m=0}^{4}\sum_{n=0}^{4} I_{i+m,j+n}K_{m,n} (I∗K)ij=m=0∑4n=0∑4Ii+m,j+nKm,n

2. 下采样公式(原始实现)

a j = β j ∑ N x N x i + b j a_j = \beta_j \sum_{NxN} x_i + b_j aj=βjNxN∑xi+bj

3. 反向传播特点

- 局部连接:仅更新对应区域的权重

- 权值共享:同一卷积核共用梯度

七、应用场景分析

| 场景 | 适用性 | 说明 |

|---|---|---|

| 手写数字识别 | ★★★★★ | 原始设计目标 |

| 简单图像分类 | ★★★★☆ | CIFAR-10等小尺寸数据集 |

| 医学影像分析 | ★★☆☆☆ | 需更深的网络结构 |

| 工业质检 | ★★★☆☆ | 配合数据增强使用 |

八、与当前CNN的对比

| 特性 | LeNet | 现代CNN |

|---|---|---|

| 网络深度 | 5层 | 50-100+层 |

| 激活函数 | Sigmoid | ReLU族 |

| 正则化 | 无 | Dropout/BatchNorm |

| 池化方式 | 平均池化 | 最大池化 |

| 输入尺寸 | 32x32 | 224x224+ |

| 典型应用 | MNIST | ImageNet |

九、实战建议

- 数据集准备:调整图像到32x32灰度格式

- 超参数调试:初始学习率设为0.01,batch_size=128

- 可视化工具:使用TensorBoard监控特征图

- 迁移学习:将卷积层作为特征提取器复用

通过理解LeNet的设计思想,可以更好掌握现代卷积神经网络的发展脉络,为学习ResNet、DenseNet等先进模型奠定基础。