各位.NET技术爱好者,大家好!我是许泽宇,今日,我们将一道深入浅出地解锁一项神奇的技术:在完全不需要GPU支持的本地环境下,如何轻松运行AI模型。无论你的设备是否配备了强大的GPU,我都将手把手教你如何运用LLamaSharp工具库,让CPU发光发热!

首先,在上一期的分享中,我们初步了解了LLamaSharp这个强大的.NET库。今天,我会进一步带大家完成模型的下载、配置、以及实际操作。

深入浅出LLamaSharp:打造智能.NET应用,不需GPU也能玩转LLaMA模型

你可能会担忧,自己没有顶级的GPU怎么办。不要着急,因为即使只有CPU,我们也能驰骋AI的领域。如何开始呢?让我们一步步来。

然后,我们直接在github下载LLamaSharp的项目代码:

https://github.com/SciSharp/LLamaSharp-

模型选择与下载

-

首先,访问著名的AI模型库:https://huggingface.co/。如果直连访问遇到困难,不妨试试神奇的代理地址:https://hf-mirror.com/。

-

在这里,我们的目标是找寻适合CPU运行的gguf格式模型。搜索结果中会展现出海量的AI模型,如此多的选择,看似琳琅满目,实则只需精确挑选。

-

对于本次实战,我选用了一个名为tinyllama-1.1b的模型。规模适中,既能体验AI的强大能力,又不会对我们的机器造成太大负担。

-

LLamaSharp带有一个WebAPI项目,我们直接使用这个项目进行测试。

将WebAPI设置为启动项目后,我们需要再

appsettings.Development.json中添加我们下载好的的模型地址。

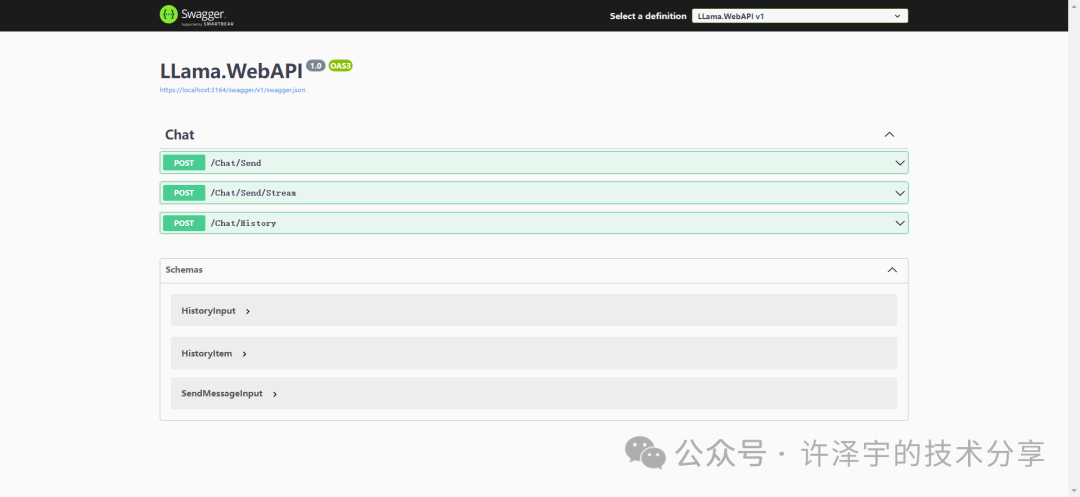

然后我们启动这个项目,启动后他没有自动打开Swagger,这个项目是具有Swagger的,我们在浏览者后面输入/swagger

带有3个接口,一个是非流式的,一个是流式的。

这里我们先使用非流式的来进行测试。

在这里,我们可以观察到,就算我使用的非流式,其实对于模型来说还是以流式的形式输出的。

我让AI介绍一下他自己

他回复我:当然我的名字叫Alyssa,是一个非常高效、知识渊博的助理

到这里,我们使用C# 本地运行模型的案例就结束了。

无需高端GPU,也能在.NET环境中轻松运行起庞大的AI模型,这正是LLamaSharp库的魅力所在。今日的分享就到这里,希望这篇文章能够助您在AI程序开发的道路上更进一步。如果您对这个话题感兴趣,敬请期待更多相关技术的深度解读!别忘了关注我,我们下回见!